У нейросетей нет дыма из трубы, нет мотора, нет выхлопной трубы, как у автомобиля. Поэтому легко поверить, будто искусственный интеллект живёт где-то в чистом цифровом вакууме и почти ничего не стоит планете. Это удобная иллюзия. На деле каждый запрос к ИИ — не магия, а работа серверов, чипов, памяти, сетей и систем охлаждения. В одном из самых подробных измерений реальной эксплуатации ИИ Google оценил медианный текстовый запрос в Gemini Apps примерно в 0,24 ватт-часа. Независимый инфраструктурный бенчмарк для крупных языковых моделей даёт для короткого запроса к GPT-4o уже около 0,43 ватт-часа, а для длинных и более «тяжёлых» сценариев значения растут на порядок и выше.

Для человека это кажется мелочью. И действительно, один такой запрос по энергии сопоставим не с поездкой на электричке, а скорее с несколькими секундами работы обычной лампы. Но масштаб тут важнее единицы: если взять даже 0,24 ватт-часа и умножить на миллиард запросов в день, получится около 240 мегаватт-часов в сутки. Это уже не «пустяк из интернета», а промышленная величина. Международное энергетическое агентство прямо пишет, что типичный дата-центр, ориентированный на ИИ, может потреблять столько же электроэнергии, сколько 100 тысяч домохозяйств, а самые крупные строящиеся объекты — в 20 раз больше. Поэтому главный тезис звучит просто: нейросети не виртуальны в экологическом смысле. Их след очень материален. Он прячется не в экране, а в электросети, трансформаторах, охлаждении и мегаваттах.

Почему нейросети вообще потребляют энергию?

Нейросеть — это не «умная коробка с ответами», а машина для огромного количества вычислений. Каждый ответ строится из множества математических операций: перемножения матриц, пересчёта вероятностей, выбора следующего токена, обращения к памяти, перемещения данных между узлами.

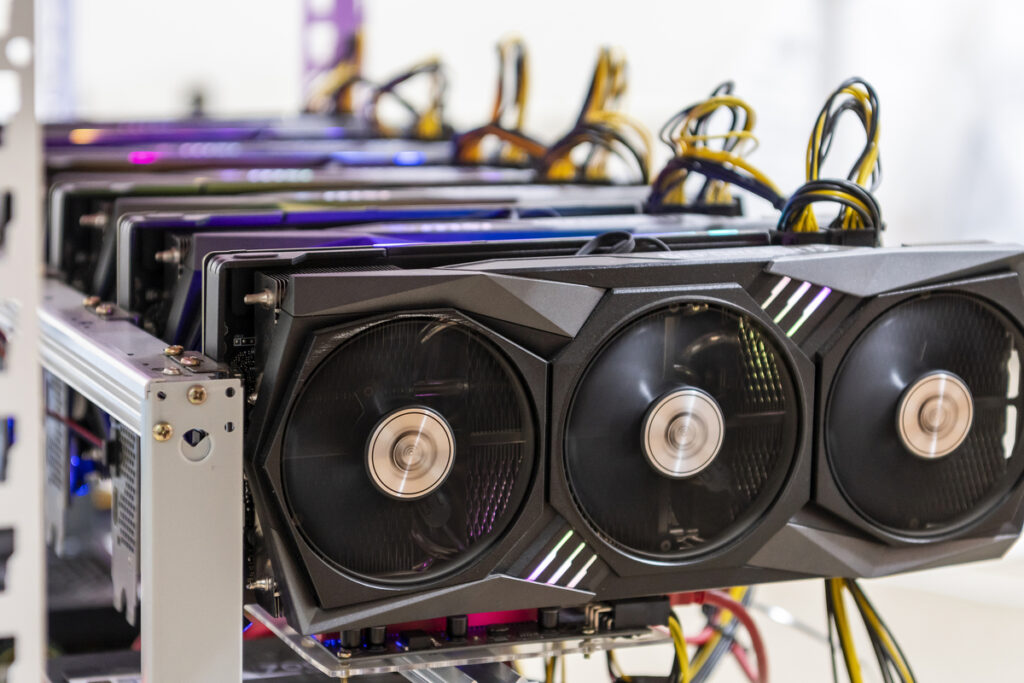

Чем больше модель, тем больше параметров она хранит и тем больше вычислительной работы нужно, чтобы выдать даже короткий текст. Большие языковые модели работают на ускорителях вроде GPU и TPU, а те, в свою очередь, требуют не только питания для самих вычислений, но и энергии для памяти, центральных процессоров, сетевого оборудования и охлаждения. В этом смысле каждый ответ действительно похож на мини-завод вычислений: вы видите одну фразу на экране, а за ней стоит цепочка машинных действий, которые происходят в дата-центре за доли секунды. На уровне инфраструктуры картина тоже не сводится только к «горячим видеокартам».

По данным IEA, системы хранения данных дают около 5% энергопотребления дата-центров, сетевое оборудование — тоже до 5%, а охлаждение и поддержание нужной среды могут занимать от примерно 7% в очень эффективных гиперскейл-центрах до более чем 30% в менее эффективных объектах. Иначе говоря, энергия уходит не только на то, чтобы модель «думала», но и на то, чтобы она не перегрелась, не потеряла соединение и всегда была готова ответить быстро. Отсюда и важный вывод: чем сложнее запрос, длиннее ответ и мощнее модель, тем выше не абстрактная, а вполне реальная цена одного разговора с ИИ.

Обучение vs использование

Долгое время разговор об экологической цене ИИ почти целиком крутился вокруг обучения моделей. Это понятно, обучение — громкий и заметный этап. Его можно представить как гигантскую кампанию: тысячи ускорителей, недели или месяцы работы, огромные наборы данных, впечатляющие суммы и заголовки в медиа. Именно поэтому ранние статьи о «грязном ИИ» чаще били по обучению.

Но научная картина постепенно изменилась. Исследователи всё чаще приходят к выводу, что в жизненном цикле популярной модели главным энергопотребителем становится не обучение, а использование. Patterson и соавторы ещё в 2021 году отмечали, что большая часть машинного обучения в облаке приходится именно на использование, а не на обучение. Более свежие работы идут дальше: симуляционная модель 2025 года оценивает, что использование может давать больше половины всех жизненных выбросов больших языковых моделей, а инфраструктурный бенчмарк 2025 года прямо пишет, что в ряде сценариев на inference может приходиться до 90% совокупного энергопотребления модели за жизненный цикл.

Модель обучают один раз или сравнительно редко. Зато потом её используют миллионы и миллиарды раз. Более того, работа ICML 2024 по показывает: если разработчик заранее ждёт очень большой спрос, оптимально делать модель меньше и обучать её дольше, потому что именно стоимость будущего использования начинает определять экономику всей системы. Самая дорогая для планеты часть ИИ сегодня — не только момент, когда лаборатория создаёт модель, а то, как часто и насколько массово мы заставляем её отвечать каждый день.

Где именно “сгорает” энергия

Когда говорят, что ИИ потребляет много электричества, воображение обычно рисует один пылающий GPU. В реальности всё сложнее и интереснее. В производственном измерении Google для текстовых запросов Gemini основная доля пришлась на активные ИИ-ускорители — около 58% всей энергии на запрос. Ещё примерно 25% дали CPU и DRAM, то есть хост-система и память. Около 10% ушло на простаивающие, но заранее подготовленные машины, а ещё около 8% — на дата-центровый overhead, который выражают через показатель PUE.

Иными словами, серверы не только думают, но и ждут, а ещё греются, и за всё это надо платить киловатт-часами. На более широком уровне IEA уточняет: охлаждение в зависимости от типа площадки может съедать от 7% до более 30% всей энергии дата-центра. У Lawrence Berkeley Lab есть ещё одна важная деталь: инфраструктурная часть — то есть не сами вычисления, а питание, распределение, инженерные системы — в 2023 году всё ещё составляла около 30% энергопотребления дата-центров США, хотя в 2014-м было около 40%.

Это хорошая и плохая новость одновременно. Хорошая — дата-центры стали эффективнее. Плохая — даже после заметного прогресса почти треть энергии уходит не на полезные вычисления как таковые. Для пользователя отсюда следует неприятный, но честный вывод: когда вы просите модель «переделать ответ ещё раз, но чуть дружелюбнее», энергия тратится не только на сам новый текст. Она тратится на всю обслуживающую экосистему вокруг ответа — от памяти до кондиционирования. Цифровой разговор оказывается физическим процессом, просто спрятанным от глаз.

Масштаб проблемы в цифрах

Самый надёжный способ понять тему — перевести её из туманных слов в числа. По данным IEA, дата-центры в 2024 году потребили около 415 тераватт-часов электроэнергии, то есть примерно 1,5% мирового потребления. К 2030 году агентство ожидает рост примерно до 945 тераватт-часов. Это уже чуть больше, чем сегодня потребляет целая Япония.

В США картина ещё жёстче: по оценке Berkeley Lab, дата-центры выросли с 58 тераватт-часов в 2014 году до 176 тераватт-часов в 2023-м, а к 2028 году могут дойти до диапазона 325–580 тераватт-часов. Деньги здесь тоже перестают быть «цифровыми». IEA пишет, что мировые инвестиции в дата-центры почти удвоились с 2022 года и достигли полутриллиона долларов в 2024-м. По официальному курсу ЦБ РФ на 21 марта 2026 года это порядка 42 триллионов рублей.

Теперь вернёмся к обычному запросу. Если взять измерение Google — 0,24 ватт-часа на медианный текстовый запрос, — то миллион таких запросов потянет примерно на 240 киловатт-часов. Если для наглядности считать по бытовому одноставочному московскому тарифу порядка 7 рублей за киловатт-час, это уже около 1,7 тысячи рублей только на электричество. Миллиард запросов — уже примерно 240 мегаватт-часов и около 1,68 миллиона рублей по той же грубой бытовой оценке. Конечно, крупные компании покупают энергию не по домашним тарифам, и их инфраструктура устроена сложнее. Но смысл этих подсчётов прост: даже доли копейки на один запрос на масштабе превращаются в крупную энергетику и крупные деньги.

Почему это стало научной проблемой

Экологическая цена ИИ перестала быть побочным замечанием и стала отдельной научной темой по двум причинам. Во-первых, масштабы выросли слишком быстро, чтобы их игнорировать. Во-вторых, сами исследователи поняли, что метрики точности больше не хватает. Нельзя всерьёз обсуждать прогресс модели, если мы знаем её score на бенчмарке, но не знаем, какой ценой по энергии, выбросам и инфраструктуре он достигнут. Эту смену оптики хорошо видно по развитию самого термина Green AI.

В программной статье Schwartz и соавторов он был сформулирован как подход, где новые результаты получают с учётом вычислительной стоимости, а не вопреки ей. Позже систематический обзор Green AI показал, что тема уже выросла в самостоятельное направление: авторы проанализировали 98 первичных исследований, зафиксировали быстрый рост публикаций и отметили, что 76% работ вышли с 2020 года и позже. Авторы прямо пишут, что поле достигло заметной зрелости и готово к переходу от академических идей к индустриальной практике. Patterson и соавторы со своей стороны предлагали сделать энергопотребление и CO₂e обычной частью отчётности по крупным моделям.

Это уже не моральный жест, а научная норма. Раньше вопрос звучал так — «насколько умна модель?». Теперь всё чаще он звучит иначе — «насколько умна модель на единицу энергии, времени и выбросов?». Это и есть момент, когда экологическая проблема перестаёт быть колонкой мнений и становится предметом измерений, методик, сравнений и инженерных решений.

Сравнение с другими технологиями

Чтобы понять масштаб проблемы, ИИ полезно сравнивать не с апокалипсисом, а с соседями по цифровому цеху. Сегодня дата-центры и сети передачи данных вместе уже потребляют заметную долю мировой электроэнергии. По оценке IEA, каждый из этих сегментов даёт примерно 1–1,5% глобального спроса. При этом криптомайнинг в 2022 году тянул ещё около 110 тераватт-часов, или примерно 0,4% мирового спроса.

ИИ — не единственный цифровой потребитель энергии. Однако именно он становится главным драйвером нового роста дата-центров к 2030 году. Это важно для трезвого разговора. Видео-стриминг тоже требует энергии, но IEA отдельно отмечает: его климатический след сегодня сравнительно умеренный благодаря росту эффективности устройств, сетей и дата-центров. У генеративного ИИ логика иная. Стриминг в основном доставляет уже готовый контент. Нейросеть же создаёт новый ответ почти заново при каждом обращении. Поэтому нагрузка на вычисления часто оказывается выше. Европейский центральный банк приводит показатель, который хорошо передаёт разницу: один запрос к ChatGPT-3 может требовать примерно в десять раз больше энергии, чем обычный поиск Google.

Это не значит, что каждый чат с ботом равен промышленной аварии. Если сервисом пользуются миллионы людей, даже маленькая разница на один запрос быстро превращается в большую разницу для энергосистемы. ИИ не страшнее всех технологий сразу, но он заметно “тяжелее” многих привычных цифровых действий. И именно поэтому его экологическую цену надо обсуждать отдельно, а не растворять в общем фоне интернета.

«Лишние запросы» и поведение пользователей

Не вся энергия ИИ определяется только размером модели. На неё сильно влияет и то, как именно человек пользуется сервисом. Она делает тему менее абстрактной. Исследование MELODI, где энергопотребление измеряли на уровне каждого отдельного запроса, показало любопытную вещь: с энергией сильнее всего связаны характеристики ответа, а не сложность исходной формулировки. У авторов длина ответа по токенам имела сильную корреляцию с энергозатратами, около 0,755.

Почти так же влияли длительность ответа и общее время генерации. А вот длина самого запроса коррелировала слабо. Самый энергозатратный пользовательский жест — не обязательно “сложный вопрос”. Часто это длинный ответ, повторная генерация и серия уточнений ради косметики. Google тоже подчёркивает практическую сторону проблемы: при миллиардах пользовательских обращений даже низкая энергия одного запроса становится значимой величиной для всей системы. Поэтому лишние перегенерации — не пустяк. Они накапливаются.

Если нужен короткий факт, не стоит просить длинную лекцию. Если ответ уже подходит, не надо перезапускать его пять раз. Если задача рутинная, лучше выбирать более лёгкий режим или модель попроще, когда такая опция доступна. Это не аскетизм и не “экологическая вина за каждый токен”, а обычная цифровая гигиена. Чем меньше бессмысленных повторов, тем ниже лишняя нагрузка на вычисления, охлаждение и сеть. Удобство при этом почти не страдает. Зато разговор об устойчивом ИИ перестаёт быть делом только инженеров и становится частью повседневного пользовательского выбора.

Экологические последствия

Главная ошибка в разговоре об ИИ — считать, что цифровое автоматически значит экологичное. Не значит. Дата-центры действительно занимают пока относительно небольшую долю мирового спроса на электроэнергию, но их локальное воздействие куда острее, чем глобальная средняя цифра. IEA прямо подчёркивает: проблема у дата-центров не только в объёме, но и в концентрации. Почти половина мощностей дата-центров в США сосредоточена в пяти региональных кластерах, а около 50% строящихся объектов там же размещаются в уже существующих узлах.

Для энергосистемы это означает не ровный фоновый рост, а точечные удары по сетям, подстанциям и очередям на подключение. Агентство оценивает, что без решения сетевых ограничений около 20% запланированных проектов дата-центров могут столкнуться с задержками. Для развитых экономик дата-центры вообще становятся одним из главных драйверов роста электрического спроса: на них может приходиться более 20% прироста потребления к 2030 году. Что это значит для нас? Не то, что его домашний счёт за один чат с ботом внезапно взлетит. Влияние другое. Нужны новые линии, новые подстанции, новые источники генерации, больше земли и иногда больше воды для охлаждения.

Если электричество приходит из грязного энергобаланса, растут и выбросы. Если сети уже загружены, возрастает конкуренция за мощность между дата-центрами, промышленностью и бытовым сектором. Поэтому экологический след ИИ — это не абстрактная забота «для учёных». Это вопрос о том, как будет выглядеть инфраструктура рядом с нами и кто в итоге оплатит расширение системы.

Что уже делают, чтобы снизить проблему

Хорошая новость в том, что отрасль не стоит на месте. Плохая — улучшения в эффективности не гарантируют уменьшения общего следа, если спрос растёт быстрее. Инженерные решения уже есть, и многие из них работают. Google в своём исследовании пишет, что за год сумел снизить энергопотребление медианного текстового запроса в Gemini Apps в 33 раза, а выбросы на запрос — в 44 раза.

Источники этого выигрыша очень показательны: улучшения самих моделей, рост загрузки машин, более эффективная доставка, чистая энергия и более эффективные дата-центры. Среди конкретных методов названы Mixture-of-Experts, где для ответа активируется только часть большой модели, более узкие числовые форматы и квантование, speculative decoding, дистилляция, а также собственные TPU с более высокой производительностью на ватт. Более общие исследования подтверждают ту же логику. Patterson и соавторы показывали, что большие, но разреженно активируемые сети могут потреблять меньше одной десятой энергии плотных моделей без потери качества, а выбор площадки, дата-центра и ускорителя способен уменьшить углеродный след на порядки.

В работе по профилированию inference для LLM отмечено, что такие техники, как квантование, пакетная обработка и адаптивное отображение с учетом аппаратного обеспечения, могут снизить энергопотребление до 73% по сравнению с неоптимизированными вариантами. Будущее не только за «самыми умными» моделями, а за моделями, которые умеют отвечать достаточно хорошо, но заметно дешевле по энергии. В мире ИИ экономность постепенно становится не компромиссом, а признаком зрелости.

Станет ли ИИ экологичным?

Дальше возможны два сценария. Первый — неприятный, но вполне реалистичный. ИИ становится дешевле, быстрее и доступнее, люди и компании используют его всё чаще, а общий спрос растёт быстрее, чем успевает улучшаться эффективность. Тогда срабатывает знакомый эффект отскока: отдельный запрос дешевеет, но суммарный след системы растёт. IEA именно это и допускает в сценарии Lift-Off: к 2035 году потребление дата-центров может превысить 1 700 тераватт-часов.

Второй сценарий мягче. В нём прогресс в железе, ПО и инфраструктуре действительно успевает компенсировать часть спроса. Тогда, по оценке IEA, при более сильном повышении эффективности потребление дата-центров в 2035 году может оказаться заметно ниже базовой траектории и составить около 970 тераватт-часов. Но сам по себе технический прогресс ничего не гарантирует. Нужны прозрачные метрики, общие стандарты отчётности, нормальная научная проверка и внимание регуляторов к размещению, водопотреблению и сетевым ограничениям. Есть и человеческий уровень. Исследование MELODI показывает, что энергопотребление сильнее всего определяется длиной ответа и временем генерации, а не сложностью формулировки как таковой.

Проще говоря, бесконечные простыни текста, многократные перегенерации и запросы к чрезмерно мощным моделям для банальных задач — это уже вопрос не только удобства, но и лишней нагрузки. Экологичным ИИ станет не тогда, когда о нём скажут красивую фразу в отчёте, а тогда, когда эффективность, прозрачность и умеренность использования станут такими же нормальными критериями, как скорость и качество ответа.

Баланс: польза vs вред

Экологический разговор об ИИ легко скатить в две крайности: либо “всё пропало”, либо “проблемы нет”. Обе позиции слабые. Реальная картина сложнее. С одной стороны, IEA ожидает, что спрос дата-центров на электричество к 2030 году вырастет примерно до 945 тераватт-часов. Главным двигателем этого роста агентство называет именно ИИ. С другой стороны, то же IEA подчёркивает: сам ИИ способен снижать издержки и потери в энергетике.

Среди уже полезных направлений агентство называет более точный прогноз выработки ветра и солнца, мониторинг и оптимизацию линий электропередачи в реальном времени, а также поиск новых химий для батарей. Это очень важный момент. ИИ не только создаёт нагрузку, но и может помогать системе работать умнее. Поэтому вопрос стоит не так: “нужен ли нам ИИ вообще?”. Гораздо полезнее другой вопрос: “в каких задачах его польза действительно перекрывает энергетическую цену?”. Там, где модель экономит ресурсы в сети, на заводе или в логистике, баланс может быть положительным. Там, где она лишь раздувает поток бессмысленного контента, выгода выглядит слабее.

Не каждый ИИ-сервис одинаково полезен. Стоит различать инструменты, которые реально экономят время, материалы или электричество, и сервисы, которые просто производят шум. Для бизнеса и государства вывод ещё жёстче. Нужны не только новые модели, но и честные критерии их пользы: сколько энергии потратили, что именно получили взамен и можно ли было решить задачу проще. Именно такой подход делает разговор об ИИ взрослее. Не запретительным, а инженерным.

Новая цена прогресса

Искусственный интеллект остаётся мощным инструментом. Он ускоряет поиск, помогает писать код, переводить тексты, анализировать данные и автоматизировать рутину. Проблема не в том, что ИИ существует. Проблема в том, что общество долго смотрело на него как на чисто цифровую сущность и почти не замечало его материальную сторону.

Теперь эта слепая зона исчезает. Исследования показывают, что один запрос действительно может стоить совсем немного по энергии. Но те же исследования показывают и другое: когда таких запросов становятся сотни миллионов и миллиарды, «немного» превращается в мегаватт-часы, новые дата-центры, инвестиции на десятки триллионов рублей и дополнительное давление на энергосистемы. Именно поэтому экологическая проблема нейросетей больше не выглядит маргинальной темой для узких специалистов. Она стала частью большого разговора о том, какой должна быть цифровая инфраструктура будущего.

Вопрос уже не только в том, насколько удобен очередной ИИ-сервис, но и в том, как он устроен, где работает, чем питается и какую цену за его «ум» платит система вокруг нас. Каждый умный ответ нейросети имеет вполне материальную цену. И чем раньше это станет общей нормой для разработчиков, регуляторов, бизнеса и пользователей, тем выше шанс, что технология будущего не окажется экологической проблемой настоящего.